| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | ||

| 6 | 7 | 8 | 9 | 10 | 11 | 12 |

| 13 | 14 | 15 | 16 | 17 | 18 | 19 |

| 20 | 21 | 22 | 23 | 24 | 25 | 26 |

| 27 | 28 | 29 | 30 |

Tags

- Stat110

- RNN

- 언리얼엔진

- GAN

- BERT

- animation retargeting

- WinAPI

- 폰트생성

- dl

- Few-shot generation

- 모션매칭

- 오블완

- UE5

- cv

- Font Generation

- Diffusion

- Generative Model

- 딥러닝

- deep learning

- userwidget

- ddpm

- CNN

- multimodal

- NLP

- 디퓨전모델

- ue5.4

- motion matching

- WBP

- 생성모델

- Unreal Engine

Archives

- Today

- Total

목록Elmo (1)

Deeper Learning

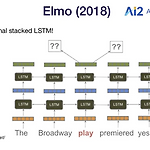

ELMo (Embeddings from Language Model)

ELMo (Embeddings from Language Model)

Beyond Embeddings Word2Vec, Glove 임베딩은 13~14년에 인기 많은 task에서 좋은 성능을 보였음 Problem: representations are shallow 첫 번째 layer만 all Wikipedia data로 pretrained한 embedding의 이점을 가짐 나머지 layer (LSTMs)는 pretrained data를 보지 못하고 own data로만 학습됨 Bank Account와 River Bank에서 Bank는 전혀 다른 의미를 가지지만 Word2Vec 또는 Glove로는 이를 반영하지 못하고 Bank가 같은 벡터로 임베딩 되어 사용됨 문맥을 반영한 워드 임베딩 (Contextualized Word Embedding)이 필요하다. → embedding ..

AI/Deep Learning

2021. 10. 8. 09:50