| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | ||

| 6 | 7 | 8 | 9 | 10 | 11 | 12 |

| 13 | 14 | 15 | 16 | 17 | 18 | 19 |

| 20 | 21 | 22 | 23 | 24 | 25 | 26 |

| 27 | 28 | 29 | 30 |

- dl

- 모션매칭

- Font Generation

- Stat110

- ddpm

- 오블완

- Unreal Engine

- animation retargeting

- 언리얼엔진

- 생성모델

- BERT

- NLP

- Diffusion

- WinAPI

- multimodal

- motion matching

- GAN

- RNN

- cv

- Few-shot generation

- 디퓨전모델

- WBP

- ue5.4

- deep learning

- userwidget

- 폰트생성

- CNN

- 딥러닝

- UE5

- Generative Model

- Today

- Total

목록ddpm (3)

Deeper Learning

Score-based Generative Models과 Diffusion Probabilistic Models과의 관계

Score-based Generative Models과 Diffusion Probabilistic Models과의 관계

Generative Modeling by Estimating Gradients of the Data Distribution https://arxiv.org/abs/1907.05600 Score-based Generative Model의 개념을 소개한 논문 Given this dataset, the goal of generative modeling is to fit a model to the data distribution such that we can synthesize new data points at will by sampling from the distribution. 생성모델에서 목표는 주어진 데이터셋을 활용하여 모델이 데이터 분포를 실제 데이터 분포와 가깝게 근사하고 구한 데이터 분포를 활용하여..

Improved-DDPM: Improved Denoising Diffusion Probabilistic Models

Improved-DDPM: Improved Denoising Diffusion Probabilistic Models

Alex Nichol, Prafulla Dhariwal (2021.02) [openAI] Abstract DDPM이 간단한 변경으로 높은 log-likelihoods 달성할 수 있다는 것을 보임 reverse diffusion 과정의 분산을 학습하면 더 적은 forward process로 큰 퀄리티 차이 없이 sampling이 가능하다는 것을 발견 GAN과 DDPM이 얼마나 타겟 분포를 커버하는지 비교하기 위해 precision, recall 사용 연산량, model capacity에 따라 샘플 퀄리티와 likelihood가 부드럽게 scaling 되는 것을 확인 https://github.com/openai/improved-diffusion GitHub - openai/improved-diffusion..

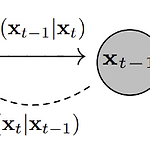

Diffusion Model 수식 정리

Diffusion Model 수식 정리

prerequisite: Diffusion Model에 대한 기초적인 이해 Diffusion Model T = 전체 Timesteps 수 xT = forward process를 T 번 적용한 마지막 Timestep T 에서의 이미지 x0 = 원본 이미지 Forward Process q(xt|xt−1)=N(xt,√1−βtxt−1,βtI) β 는 noise(variance)의 강도를 조절하는 parameter로 DDPM 논문에서는 0.0001 ~ 0.02의 값을 사용 β 가 선형적으로 timesteps에 따라(DDPM에서는 linear noise scheduler 사용) 0.0001에서 0.02까지 증가하..